人工智能引起的伦理问题

随着人工智能(AI)的快速发展,其广泛应用在各个领域,如医疗、金融、交通、教育等。AI的应用也带来了一系列伦理问题。本文将就道德决策制定、算法偏见和歧视、隐私问题和数据保护、工作和就业机会、人机交互和人类价值观、责任和问责制度、教育和意识提升、法律和监管框架、国际合作与全球标准等方面,探讨AI引起的伦理问题。

一、道德决策制定

AI的道德决策制定是AI伦理的核心问题之一。由于AI系统是由人类设计和编程的,因此其决策过程往往反映了设计者的价值观和偏见。因此,在AI系统的设计和使用过程中,需要考虑其道德决策的影响,并尽量避免产生负面影响。

二、算法偏见和歧视

由于AI系统的算法是由人类设计的,因此可能会出现偏见和歧视的现象。例如,在招聘过程中,使用AI系统进行简历筛选,如果该系统只考虑某些特定的关键词,而忽略其他优秀的候选人,就会导致招聘结果的偏见和歧视。因此,在设计和使用AI系统时,需要特别注意避免算法偏见和歧视的问题。

三、隐私问题和数据保护

随着大数据的发展,AI系统的数据来源越来越广泛。在AI系统的使用过程中,往往需要收集大量的个人信息、行为数据等敏感信息。因此,保护用户的隐私和数据安全是AI伦理的重要问题之一。在设计和使用AI系统时,需要严格遵守相关的隐私政策和数据保护法规,确保用户的隐私和数据安全。

四、工作和就业机会

AI的快速发展可能会对传统的工作和就业机会产生冲击。例如,自动化和机器人化可能会取代一些传统的工作岗位,导致失业问题的加剧。因此,在设计和使用AI系统时,需要考虑其对工作和就业机会的影响,并采取相应的措施,如提供再培训和教育机会等,以帮助受影响的人群适应新的就业环境。

五、人机交互和人类价值观

随着AI技术的不断发展,人机交互变得越来越普遍。AI系统不仅在各个领域得到了广泛应用,而且也成为了人们日常生活的一部分。在人机交互过程中,往往会出现一些与人类价值观相冲突的情况。例如,自动驾驶汽车在面临紧急情况时,需要做出决策以保护乘客的安全和其他道路使用者的生命财产安全。这种决策往往涉及到道德和伦理问题,需要考虑到人类价值观和社会公义等因素。

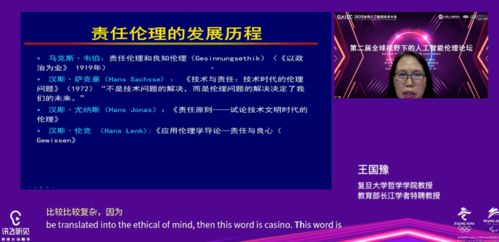

六、责任和问责制度

由于AI系统是由人类设计和编程的,因此其决策和行为往往受到设计者和使用者的控制和影响。在某些情况下,AI系统的决策和行为可能会出现不可预测的结果和不道德的行为。因此,建立责任和问责制度是AI伦理的重要问题之一。在设计和使用AI系统时,需要明确设计者和使用者的责任和义务,并建立相应的问责制度以追究相关责任人的法律责任和社会责任。

七、教育和意识提升

为了解决AI伦理问题,需要提高公众对AI技术的认识和了解程度。通过教育和宣传活动,使公众更加了解AI技术的优点和潜在的风险和危害。同时,也需要提高技术人员的道德意识和社会责任感,促使其在设计和使用AI系统时充分考虑伦理问题并采取相应的措施。

八、法律和监管框架

为了保障公共利益和个人的权益,需要建立完善的法律和监管框架来规范AI技术的发展和应用。在法律方面,需要制定相应的法律法规来规范AI技术的研发和应用过程;在监管方面,需要建立相应的监管机制来保障AI技术的安全和合规性等方面的要求。同时,也需要加强国际合作来共同制定相关法律和标准以促进AI技术的健康发展。